Bienvenidos

Hola a todos los que visitan nuestro blog

espero que les guste nuestra presentacion

tanto como la información, imagenes

y actividades....

Para evaluar tus ejercicios, envianos un correo a la siguiente direccion imprimiendo la pantalla de tus ejercicios realizados : Contactanos a Los_ingesrake@hotmail.com

Gracias por tu visita...

Te saludamos Los inges y feliz Navidad

espero que les guste nuestra presentacion

tanto como la información, imagenes

y actividades....

Para evaluar tus ejercicios, envianos un correo a la siguiente direccion imprimiendo la pantalla de tus ejercicios realizados : Contactanos a Los_ingesrake@hotmail.com

Gracias por tu visita...

Te saludamos Los inges y feliz Navidad

Los circuitos de conmutación y temporización, o circuitos lógicos, forman la base de cualquier dispositivo en el que se tengan que seleccionar o combinar señales de manera controlada. Entre los campos de aplicación de estos tipos de circuitos pueden mencionarse la conmutación telefónica, las transmisiones por satélite y el funcionamiento de las computadoras digitales.

Electrónicamente se les asigna a cada uno un voltaje o rango de voltaje determinado, a los que se les denomina niveles lógicos, típicos en toda señal digital. Por lo regular los valores de voltaje en circuitos electrónicos pueden ir desde 1.5, 3, 5, 9 y 18 Volts dependiendo de la aplicación, así por ejemplo, en un radio de transistores convencional las tensiones de voltaje son por lo regular de 5 y 12 Volts al igual que se utiliza en los discos duros IDE de computadora.

Electrónicamente se les asigna a cada uno un voltaje o rango de voltaje determinado, a los que se les denomina niveles lógicos, típicos en toda señal digital. Por lo regular los valores de voltaje en circuitos electrónicos pueden ir desde 1.5, 3, 5, 9 y 18 Volts dependiendo de la aplicación, así por ejemplo, en un radio de transistores convencional las tensiones de voltaje son por lo regular de 5 y 12 Volts al igual que se utiliza en los discos duros IDE de computadora.

Los bloques elementales de un dispositivo lógico se denominan puertas lógicas digitales. Una puerta Y (AND) tiene dos o más entradas y una única salida.Según esto los Cis se clasifican en los siguientes niveles o escalas de integración :

SSI ( pequeña escala ) : menor de 10 puertas.

MSI ( media escala ) : entre 10 y 100 puertas.

LSI ( alta escala ) : entre 100 y 10.000 puertas.

VLSI ( muy alta escala ) : a partir de 10.000 puertas. La salida de una puerta Y es verdadera sólo si todas las entradas son verdaderas. Una puerta O (OR) tiene dos o más entradas y una sola salida. La salida de una puerta O es verdadera si cualquiera de las entradas es verdadera, y es falsa si todas las entradas son falsas. Una puerta INVERSORA (INVERTER) tiene una única entrada y una única salida, y puede convertir una señal verdadera en falsa, efectuando de esta manera la función negación (NOT).

La capacidad de integración depende fundamentalmente de dos factores :

SSI ( pequeña escala ) : menor de 10 puertas.

MSI ( media escala ) : entre 10 y 100 puertas.

LSI ( alta escala ) : entre 100 y 10.000 puertas.

VLSI ( muy alta escala ) : a partir de 10.000 puertas. La salida de una puerta Y es verdadera sólo si todas las entradas son verdaderas. Una puerta O (OR) tiene dos o más entradas y una sola salida. La salida de una puerta O es verdadera si cualquiera de las entradas es verdadera, y es falsa si todas las entradas son falsas. Una puerta INVERSORA (INVERTER) tiene una única entrada y una única salida, y puede convertir una señal verdadera en falsa, efectuando de esta manera la función negación (NOT).

La capacidad de integración depende fundamentalmente de dos factores :

- El ÁREA ocupada por cada puerta, que depende a su vez del tipo y del número de transistores utilizados para realizarla. Cuanto menor sea esta área mayor será la capacidad de integración a gran escala.

- El CONSUMO de potencia. En un circuito integrado se realizan muchas puertas en un espacio reducido. El consumo total del chip es igual al consumo de cada puerta por el número de puertas. Si el consumo de cada puerta es elevado se generará mucho calorcalor no es disipado convenientemente se producirá un aumento de temperatura que puede provocar un funcionamiento anómalo de los circuitos. en el chip debido al efecto Joule, de forma que si este

La primera es la representación de una compuerta AND de 2 entradas y la segunda de una compuerta AND de 3 entradas.

La compuerta Y lógica más conocida tiene dos entradas A y B, aunque puede tener muchas más (A,B,C, etc.) y sólo tiene una salida X.

Circuito Digital ' Or '

La salida X de la compuerta OR será "1" cuando la entrada "A" o la entrada "B" estén en "1".

Expresándolo en otras palabras:

En una compuerta OR, la salida será "1", cuando en cualquiera de sus entradas haya un "1".

Circuitos Digital ' Not '

Dentro de la electrónica digital, no se podrían lograr muchas cosas si no existiera la compuerta NOT o compuerta No, también llamada compuerta inversora

La compuerta NOT como la compuerta AND y la compuerta OR es muy importante. La compuerta NOT entrega en su salida el inverso (opuesto) de la entrada.

La salida de una compuerta NOT tiene el valor inverso al de su entrada. En el caso del gráfico anterior la salida X = A

Esto significa que:

- Si a la entrada tenemos un "1" lógico, a la salida hará un "0" lógico y ...

- Si a la entrada tenemos un "0" lógico a la salida habrá un "1" lógico.

- Si a la entrada tenemos un "1" lógico, a la salida hará un "0" lógico y ...

- Si a la entrada tenemos un "0" lógico a la salida habrá un "1" lógico.

Ejercicio 1.

A continuacion prueba esta sopa de letras..

Ejercicio 2.

Acontinuacion te divertiras respondiendo estas preguntas XD...

¿Que es lógica digital?

¿Con tus propias palabras para que sirver?

¿Realiza 3 ejemplos sobres logica digital?

¿En que niveles o escalas se clasifican los Cis?

¿Que son los Transistores?

¿Cuales son los 2 factores fundamentales que depende la integracion?

Publicado por : Raul Emilio Santoscoy Perez

Álgebra de Boole (también llamada Retículas booleanas) en informática y matemática, es una estructura algebraica que rigorizan las operaciones lógicas Y, O y NO, así como el conjunto de operaciones unión, intersección y complemento.

Se denomina así en honor a George Boole, (2 de noviembre de 1815 a 8 de diciembre de 1864), matemático inglés que fue el primero en definirla como parte de un sistema lógico a mediados del siglo XIX.

Se denomina así en honor a George Boole, (2 de noviembre de 1815 a 8 de diciembre de 1864), matemático inglés que fue el primero en definirla como parte de un sistema lógico a mediados del siglo XIX.

El álgebra de Boole fue un intento de utilizar las técnicas algebraicas para tratar expresiones de la lógica proposicional.

En la actualidad, el álgebra de Boole se aplica de forma generalizada en el ámbito del diseño electrónico. Claude Shannon fue el primero en aplicarla en el diseño de circuitos de conmutación eléctrica biestables, en 1938.

El álgebra de Boole es un retículo (A, , +), donde el conjunto A esta formado por dos elementos A={0, 1}, como retículo presenta las siguientes propiedades, las leyes principales son estas:

, +), donde el conjunto A esta formado por dos elementos A={0, 1}, como retículo presenta las siguientes propiedades, las leyes principales son estas:

1. Ley de Idempotencia:

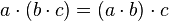

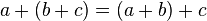

2. Ley de Asociatividad:

Se denomina así en honor a George Boole, (2 de noviembre de 1815 a 8 de diciembre de 1864), matemático inglés que fue el primero en definirla como parte de un sistema lógico a mediados del siglo XIX.

Se denomina así en honor a George Boole, (2 de noviembre de 1815 a 8 de diciembre de 1864), matemático inglés que fue el primero en definirla como parte de un sistema lógico a mediados del siglo XIX.El álgebra de Boole fue un intento de utilizar las técnicas algebraicas para tratar expresiones de la lógica proposicional.

En la actualidad, el álgebra de Boole se aplica de forma generalizada en el ámbito del diseño electrónico. Claude Shannon fue el primero en aplicarla en el diseño de circuitos de conmutación eléctrica biestables, en 1938.

El álgebra de Boole es un retículo (A,

, +), donde el conjunto A esta formado por dos elementos A={0, 1}, como retículo presenta las siguientes propiedades, las leyes principales son estas:

, +), donde el conjunto A esta formado por dos elementos A={0, 1}, como retículo presenta las siguientes propiedades, las leyes principales son estas:1. Ley de Idempotencia:

2. Ley de Asociatividad:

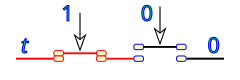

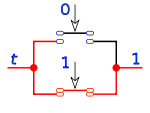

Operación suma

La operación suma (+) asigna a cada par de valores a, b de A un valor c de A:

Su equivalencia en lógica de interruptores es un circuito de dos interruptores en paralelo.

Si uno de los valores de a o b es 1, el resultado será 1, es necesario que los dos sumandos sean 0, para que el resultado sea 0.

Ejercicio 1Teorema lB (principio de dualidad). Demostrar que cada aserción o identidad algebraica deducible de los postulados del álgebra de Boole sigue siendo válida si las operaciones ” + ” y ” . ” y los elementos identidad (1 y 0) se intercambian entre si.Ejercicio 2De las siguientes sentencias o frases, ¿cuales representan proposiciones?a) 3 es un número primo b) cuando se añade 5 a 7, la suma es 14 c) Existen seres vivos en Venus d) Esta sentencia que Vd está leyendo es falsa e) ¿Es primo el número ll?

Si la sentencia p es“el buen tiempo es agradable”

escribir p’ de varias formas. Publicado por : Ismael Alfonso Iturbe Izquierdo

EL MODELO DE VON NEUMANN

La maquina de Von Neumann tenia 5 partes básicas: La memoria, la unidad Aritmética lógica, la unidad de control del programa y los equipos de entrada y salida. La memoria constaba de 4096 palabras, cada una con 40 bits (0 o 1). Cada palabra podía contener 2 instrucciones de 20 bits o un número entero de 39 bits y su signo. Las instrucciones tenían 8 bits dedicados a señalar el tiempo de la misma y 12 bits para especificar alguna de las 4096 palabras de la memoria.

La maquina de Von Neumann tenia 5 partes básicas: La memoria, la unidad Aritmética lógica, la unidad de control del programa y los equipos de entrada y salida. La memoria constaba de 4096 palabras, cada una con 40 bits (0 o 1). Cada palabra podía contener 2 instrucciones de 20 bits o un número entero de 39 bits y su signo. Las instrucciones tenían 8 bits dedicados a señalar el tiempo de la misma y 12 bits para especificar alguna de las 4096 palabras de la memoria.

Dentro de la unidad aritmética - lógica, el antecedente directo actual CPU (Unidad central de Proceso), había un registro interno especial de 40 bits llamado en acumulador. Una instrucción típica era sumar una palabra de la memoria al acumulador o almacenar éste en la memoria.

La máquina no manejaba la aritmética de punto flotante, porque Von Neumann pensaba que cualquier matemático competente debería ser capaz de llevar la cuenta del punto decimal (en este caso del punto binario), mentalmente.

La máquina no manejaba la aritmética de punto flotante, porque Von Neumann pensaba que cualquier matemático competente debería ser capaz de llevar la cuenta del punto decimal (en este caso del punto binario), mentalmente.

Un elemento importante del hardware de la PC es la unidad del sistema, que contiene una tarjeta de sistema, fuente de poder y ranuras de expansión para tarjetas opcionales. Los elementos de la tarjeta de sistema son un microprocesador, memoria de solo lectura (ROM) y memoria de acceso aleatorio (RAM).

El cerebro de la PC y compatibles es un microprocesador basado en la familia 8086 de Intel, que realiza todo el procesamiento de datos e instrucciones. Los procesadores varían en velocidad y capacidad de memoria, registros y bus de datos. Un bus de datos transfiere datos entre el procesador, la memoria y los dispositivos externos.

El cerebro de la PC y compatibles es un microprocesador basado en la familia 8086 de Intel, que realiza todo el procesamiento de datos e instrucciones. Los procesadores varían en velocidad y capacidad de memoria, registros y bus de datos. Un bus de datos transfiere datos entre el procesador, la memoria y los dispositivos externos.

Unidad de Memoria Principal

La memoria principal esta formada por un conjunto de unidades llamadas palabras. Dentro de cada una de estas palabras se guarda la información que constituye una instrucción o parte de ella (puede darse el caso de que una sola instrucción necesite varia palabras), o un dato o parte de un dato (también un dato puede ocupar varias palabras).

A la cantidad de palabras que forman la MP se le denomina capacidad de memoria. De este modo, cuanto mayor sea el numero de palabras mayor será el numero de instrucciones y datos que podrá almacenar la computadora.

Una palabra esta formada a su vez de unidades mas elementales llamadas bits, del mismo modo que en el lenguaje natural una palabra esta formada por letras. Cada bit solo puede guardar dos valores, el valor 0 o el valor 1; por eso se dice que son elementos binarios.

El numero de bits que forman una palabra se llama longitud de palabra. Por regla general, las computadoras potentes tienen memorias con longitud de palabra grande, mientras que las computadoras pequeñas tienen memorias con longitud de palabra menor.

Bueno aqui les Dejo un ejercicio par que se diviertan un crucigrama¡¡¡

http://www.estudiargratis.com.ar/crucigramas/crucigrama-de-windows.html

Solamente le damos clik al cuadro que queramos resolver y el juego emepezara¡¡

La maquina de Von Neumann tenia 5 partes básicas: La memoria, la unidad Aritmética lógica, la unidad de control del programa y los equipos de entrada y salida. La memoria constaba de 4096 palabras, cada una con 40 bits (0 o 1). Cada palabra podía contener 2 instrucciones de 20 bits o un número entero de 39 bits y su signo. Las instrucciones tenían 8 bits dedicados a señalar el tiempo de la misma y 12 bits para especificar alguna de las 4096 palabras de la memoria.

La maquina de Von Neumann tenia 5 partes básicas: La memoria, la unidad Aritmética lógica, la unidad de control del programa y los equipos de entrada y salida. La memoria constaba de 4096 palabras, cada una con 40 bits (0 o 1). Cada palabra podía contener 2 instrucciones de 20 bits o un número entero de 39 bits y su signo. Las instrucciones tenían 8 bits dedicados a señalar el tiempo de la misma y 12 bits para especificar alguna de las 4096 palabras de la memoria.Dentro de la unidad aritmética - lógica, el antecedente directo actual CPU (Unidad central de Proceso), había un registro interno especial de 40 bits llamado en acumulador. Una instrucción típica era sumar una palabra de la memoria al acumulador o almacenar éste en la memoria.

La máquina no manejaba la aritmética de punto flotante, porque Von Neumann pensaba que cualquier matemático competente debería ser capaz de llevar la cuenta del punto decimal (en este caso del punto binario), mentalmente.

La máquina no manejaba la aritmética de punto flotante, porque Von Neumann pensaba que cualquier matemático competente debería ser capaz de llevar la cuenta del punto decimal (en este caso del punto binario), mentalmente.Un elemento importante del hardware de la PC es la unidad del sistema, que contiene una tarjeta de sistema, fuente de poder y ranuras de expansión para tarjetas opcionales. Los elementos de la tarjeta de sistema son un microprocesador, memoria de solo lectura (ROM) y memoria de acceso aleatorio (RAM).

El cerebro de la PC y compatibles es un microprocesador basado en la familia 8086 de Intel, que realiza todo el procesamiento de datos e instrucciones. Los procesadores varían en velocidad y capacidad de memoria, registros y bus de datos. Un bus de datos transfiere datos entre el procesador, la memoria y los dispositivos externos.

El cerebro de la PC y compatibles es un microprocesador basado en la familia 8086 de Intel, que realiza todo el procesamiento de datos e instrucciones. Los procesadores varían en velocidad y capacidad de memoria, registros y bus de datos. Un bus de datos transfiere datos entre el procesador, la memoria y los dispositivos externos. Unidad de Memoria Principal

La memoria principal esta formada por un conjunto de unidades llamadas palabras. Dentro de cada una de estas palabras se guarda la información que constituye una instrucción o parte de ella (puede darse el caso de que una sola instrucción necesite varia palabras), o un dato o parte de un dato (también un dato puede ocupar varias palabras).

A la cantidad de palabras que forman la MP se le denomina capacidad de memoria. De este modo, cuanto mayor sea el numero de palabras mayor será el numero de instrucciones y datos que podrá almacenar la computadora.

Una palabra esta formada a su vez de unidades mas elementales llamadas bits, del mismo modo que en el lenguaje natural una palabra esta formada por letras. Cada bit solo puede guardar dos valores, el valor 0 o el valor 1; por eso se dice que son elementos binarios.

El numero de bits que forman una palabra se llama longitud de palabra. Por regla general, las computadoras potentes tienen memorias con longitud de palabra grande, mientras que las computadoras pequeñas tienen memorias con longitud de palabra menor.

Ya se ha visto en las secciones precedentes como funcionan la CPU y la MP, pero puede decirse que es necesaria la comunicación entre el interior de la computadora y su entorno o periferia. Esta comunicación se consigue a través de dispositivos de muy diversos tipos, como son: teclados, impresoras, pantallas, discos magnéticos, etc.

Es estos dispositivos se les conoce con el nombre genérico de periféricos.

En la figura 1.4 se muestran algunos periféricos conectados a la Unidad de E/S, la cual hace de intermediaria entre los periféricos y la CPU. Las flechas indican el sentido en que fluye la información. Bueno aqui les Dejo un ejercicio par que se diviertan un crucigrama¡¡¡

http://www.estudiargratis.com.ar/crucigramas/crucigrama-de-windows.html

Solamente le damos clik al cuadro que queramos resolver y el juego emepezara¡¡

¿Cuales son las 5 partes basicas de la Maquina de Von Neumann?

Publicado por: Jose Eder Juarez Del Castillo

Según Von Neumann, la clave para construir una máquina de propósito general es poder almacenar no sólo los datos y los resultados intermedios de una computación, sino también las instrucciones que definen el procedimiento de computación. En una máquina de propósito especifico, el procedimiento puede ser parte de la máquina. Sin embargo, en una máquina de propósito general, cambiar las instrucciones tiene que ser tan fácil como cambiar los datos sobre los que actúan. La solución es codificar las instrucciones de forma numérica y guardarlas junto con los datos en la misma memoria. Este es el concepto de programa almacenado.

Los primeros computadores no se diferenciaban mucho de las máquinas de propósito específico que hay hoy en día, en el sentido que sólo pueden resolver un tipo particular de problema. El aporte de Von Neumann fue precisamente hacer ver la necesidad de separar el programa de la máquina misma, para así poder reconfigurar el computador según fuese necesario.

El concepto del programa almacenado, un concepto teórico muy importante que fue establecido por el matemático John Von Neumann el 30 de junio de 1945 en un borrador sobre el diseño de la EDVAC. A diferencia de los primeros computadores, Von Neumann proponía que tanto el programa como sus datos fueran almacenados en la memoria del computador. Esto no solo simplificaba la labor de programación al no tener que llevar a cabo el recableado del computador sino que además libraba y generalizaba el diseño del hardware para hacerlo independiente de cualquier problema y enfocado al control y ejecución del programa. Este concepto fue tan importante y decisivo que dio lugar al concepto de la arquitectura de von Neumann, aún presente en nuestros días.

El Concepto de Von Neumann.

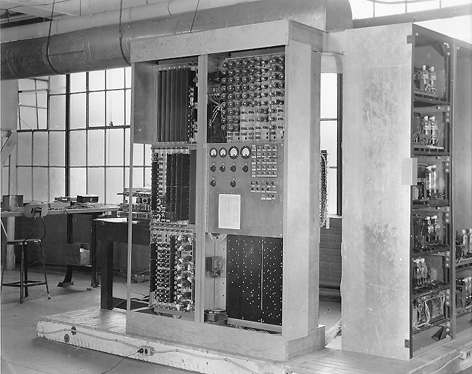

Los primeros computadores se programaban en realidad recableándolos. Esto prácticamente equivalía a reconstruir todo el computador cuando se requería de un nuevo programa. La tarea era simplificada gracias a un panel de contactos (muy similar al de los primeros conmutadores telefónicos que eran atendidos por operadoras, y que hoy en día sólo llegamos a ver en viajes películas en blanco y negro)con el que era posible enlazar circuitos para crear secciones dedicadas a una actividad específicas. La programación del computador se llevaba a cabo, literalmente, reconstruyéndolo.

ENIAC, primer computador electrónico y su panel de conexiones

Mientras que el recablear al computador establecía una clara distinción entre los datos (representados por los estados o señales eléctricas que serín mantenidas por los relevadores o a través de los bulbos que conformaban al computador) y el programa (las conexiones que serían establecidas entre estos componentes del hardware) la labor de "programación" requería sino del propio creador del computador si a un verdadero experto y conocedor de electrónica, principios de lógica digital y del problema mismo.

Esto vino a cambiar con el concepto del programa almacenado, un concepto teórico muy importante que fue establecido por el matemático John Von Neumann el 30 de junio de 1945 en un borrador sobre el diseño de la EDVAC. A diferencia de los primeros computadores, Von Neumann proponía que tanto el programa como sus datos fueran almacenados en la memoria del computador.Esto no solo simplificaba la labor de programación al no tener que llevar a cabo el recableado del computador sino que además libraba y generalizaba el diseño del hardware para hacerlo independientede cualquier problema y enfocado al control y ejecución del programa. Este concepto fue tan importante y decisivo que dio lugar al concepto de la arquitectura de Von Neumann, aún presente en nuestros días.

Esto vino a cambiar con el concepto del programa almacenado, un concepto teórico muy importante que fue establecido por el matemático John Von Neumann el 30 de junio de 1945 en un borrador sobre el diseño de la EDVAC. A diferencia de los primeros computadores, Von Neumann proponía que tanto el programa como sus datos fueran almacenados en la memoria del computador.Esto no solo simplificaba la labor de programación al no tener que llevar a cabo el recableado del computador sino que además libraba y generalizaba el diseño del hardware para hacerlo independientede cualquier problema y enfocado al control y ejecución del programa. Este concepto fue tan importante y decisivo que dio lugar al concepto de la arquitectura de Von Neumann, aún presente en nuestros días. La arquitectura de von Neumann se compone de tres elementos:

- La Unidad Central de Procesamiento (CPU, por sus siglas en inglés), que es considerada como el cerebro y corazón del computador. Internamente consiste de una Unidad Aritmético-Lógica (ALU), un conjunto de registros y una Unidad de Control (CU). La ALU es donde se realizan todas las operaciones que involucran un procesamiento matemático (particularmente aritmético) o lógico (operaciones booleanas). Los registros permiten el almacenammiento de datos para estas operaciones y sus resultados. En la CU es donde se ejecutan todo el resto de las operaciones (decisión, control, movimiento de datos). Una CPU con todos estos elementos implementada en un solo chip recibe el nombre de microprocesador.

- La memoria, que es donde datos y programa es almacenado. La memoria puede ser visto como un arreglo unidimensional finito en la que cada localidad es identificada por un valor asociado a su posición y que es comunmente llamado dirección. Existen diversos tipos de memoria, identificados por el tipo de tecnología usada, aunque para un computador son generalmente clasificadas en dos grandes grupos por tipo de uso al que de destina. La memoria RAM (Random Access Memory, Memoria de Acceso Aleatorio) y que es aquella destinada al almacenamiento de datos y programas (incluyendo al sistema operativo), es considerada temporal o de tipo volátil ya que pierde si contenido cuendo el computador es apagadoo reinicializado. La memoria ROM es aquella de tipo permanente, aun cuando el computador sea desenergizado mantendrá su contenido. Es usada principalmente para el almacenamiento de pequeños programas destinados a la adminsitración básica de recursos, especialmente de entrada y salida.

- Las interfaces de entrada y salida (I/O). destinadas a liberar de trabajo a la CPU en la comunidación con dispositivos de entrada (teclados, ratones), salida (impresoras) y entrada-salidas (discos, cintas).

A continuacion podran ver un video acerca del condepo de Jhon Von Neumann

Ejercicio 1

Explica con tus propias palabras para ti que es el concepto de programa almacenado:

Ejercicio 2

¿Cual fue el primer computador electronico y su panel de conexiones?

Publicado por : Raul Saldaña Ramirez "el guapo"

Lenguaje de máquina es el sistema de códigos directamente interpretable por un circuito microprogramable, como el microprocesador de una computadora o el microcontrolador de un autómata (un PLC) . Este lenguaje está compuesto por un conjunto de instrucciones que determinan acciones a ser tomadas por la máquina. Un programa de computadora consiste en una cadena de estas instrucciones de lenguaje de máquina (más los datos).

Lenguaje de máquina es el sistema de códigos directamente interpretable por un circuito microprogramable, como el microprocesador de una computadora o el microcontrolador de un autómata (un PLC) . Este lenguaje está compuesto por un conjunto de instrucciones que determinan acciones a ser tomadas por la máquina. Un programa de computadora consiste en una cadena de estas instrucciones de lenguaje de máquina (más los datos).Estas instrucciones son normalmente ejecutadas en secuencia, con eventuales cambios de flujo causados por el propio programa o eventos externos. El lenguaje de máquina es específico de cada máquina o arquitectura de la máquina, aunque el conjunto de instrucciones disponibles pueda ser similar entre ellas.

Los circuitos microprogramables son sistemas digitales, lo que significa que trabajan con dos únicos niveles de tensión. Dichos niveles, por abstracción, se simbolizan con el cero, 0, y el uno, 1, por eso el lenguaje de máquina sólo utiliza dichos signos. Esto permite el empleo de las teorías del álgebra booleana y del sistema binario en el diseño de este tipo de circuitos y en su programación.

Una visión típica de la arquitectura de computadores como una serie de capas de abstracción: hardware, firmware, ensamblador, kernel, sistema operativo y aplicaciones

Ejercicio 1

¿En que consiste un programa de computadora?

Ejercicio 2

¿Que significan las siglas PLC?

Publicado por : Jose Eder Juarez Del Castillo

Ciclo de Instrucción

Un ciclo de instrucción (tambien llamado ciclo de traer y ejecutar) es el período de tiempo durante el cual un ordenador lee y procesa una instrucción de lenguaje máquina de su memoria o la secuencia de acciones que la unidad central (CPU) funciona para ejecutar cada instrucción de código de máquina en un programa.

El nombre el ciclo traer-y-ejecutar comúnmente es usado.La instrucción debe ser traída de la memoria principal, y luego ejecutado por la CPU.Esto es fundamentalmente como un ordenador funciona, con su lectura de CPU y ejecución de una serie de instrucciones escritas en su lenguaje máquina.De esto surgen todas las funciones de un ordenador familiar a partir del final del usuario.

Ciclo de Instruccion:

La CPU de cada ordenador puede tener ciclos diferentes basados en juegos de instrucción diferentes.

Traer la instruccion desde la memoria principal:

La CPU presenta el valor de la PC sobre el bus de dirección.La CPU entonces trae la instrucción de la memoria principal vía el bus de datos en el Registro de Datos de Memoria (MDR).El valor del MDR entonces es colocado en el Registro de Instrucción Actual un circuito que sostiene la instrucción de modo que pueda ser descifrado y ejecutado.

Decodificar la instrucion:

El decodificador de instrucción interpreta y pone en práctica la instrucción.

Registros que son críticos al ciclo ejecutar traída:

El registro de instrucción (IR) – mantiene la instrucción actual. La PC – sostiene la dirección en la memoria de la siguiente instrucción a ser ejecutada.

Traer archivos desde la memoria principal:

Lea la dirección eficaz de la memoria principal si la instrucción tiene una dirección indirecta. Traer requiere datos de la memoria principal para ser procesada y colocado en registros.

Ejecutar la Instruccion:

Del registro de instrucción, los datos que forman la instrucción son descifrados por la unidad de control.Esto entonces pasa la información descifrada como una secuencia de señales de control a las unidades de función relevantes de la CPU para realizar las acciones requeridas por la instrucción como la lectura de valores de registros,pasandolos a la unidad Aritmética lógica (ALU) para añadirlos juntos y escribiendo el resultado de vuelta al registro.Una señal de condición es enviada de regreso a la unidad de control por ALU si está implicado.

Almacenar Resultados:

El resultado generado por la operación es almacenado en la memoria principal, o enviado a un dispositivo de salida. Basado en la regeneración de condición del ALU, la PC es incrementada para dirigir la siguiente instrucción o para actualizar a diferentes direcciones de donde sera traida la siguiente instruccion. El ciclo entonces es repetido.

Ejercicio 1

¿Que es MDR?

Ejercicio 2

¿Como se le es llamado a un ciclo de instruccion?

Un ciclo de instrucción (tambien llamado ciclo de traer y ejecutar) es el período de tiempo durante el cual un ordenador lee y procesa una instrucción de lenguaje máquina de su memoria o la secuencia de acciones que la unidad central (CPU) funciona para ejecutar cada instrucción de código de máquina en un programa.

Ciclo de Instruccion:

La CPU de cada ordenador puede tener ciclos diferentes basados en juegos de instrucción diferentes.

Traer la instruccion desde la memoria principal:

La CPU presenta el valor de la PC sobre el bus de dirección.La CPU entonces trae la instrucción de la memoria principal vía el bus de datos en el Registro de Datos de Memoria (MDR).El valor del MDR entonces es colocado en el Registro de Instrucción Actual un circuito que sostiene la instrucción de modo que pueda ser descifrado y ejecutado.

Decodificar la instrucion:

El decodificador de instrucción interpreta y pone en práctica la instrucción.

Registros que son críticos al ciclo ejecutar traída:

El registro de instrucción (IR) – mantiene la instrucción actual. La PC – sostiene la dirección en la memoria de la siguiente instrucción a ser ejecutada.

Traer archivos desde la memoria principal:

Lea la dirección eficaz de la memoria principal si la instrucción tiene una dirección indirecta. Traer requiere datos de la memoria principal para ser procesada y colocado en registros.

Ejecutar la Instruccion:

Del registro de instrucción, los datos que forman la instrucción son descifrados por la unidad de control.Esto entonces pasa la información descifrada como una secuencia de señales de control a las unidades de función relevantes de la CPU para realizar las acciones requeridas por la instrucción como la lectura de valores de registros,pasandolos a la unidad Aritmética lógica (ALU) para añadirlos juntos y escribiendo el resultado de vuelta al registro.Una señal de condición es enviada de regreso a la unidad de control por ALU si está implicado.

Almacenar Resultados:

El resultado generado por la operación es almacenado en la memoria principal, o enviado a un dispositivo de salida. Basado en la regeneración de condición del ALU, la PC es incrementada para dirigir la siguiente instrucción o para actualizar a diferentes direcciones de donde sera traida la siguiente instruccion. El ciclo entonces es repetido.

Ejercicio 1

¿Que es MDR?

Ejercicio 2

¿Como se le es llamado a un ciclo de instruccion?

Publicado por : Karla Denisse Medina Reyes

Un algoritmo es un conjunto finito de instrucciones o pasos que sirven para ejecutar una tarea y/o resolver un problema. De un modo más formal, un algoritmo es una secuencia finita de operaciones realizables, no ambiguas, cuya ejecución da una solución de un problema en un tiempo finito.

Un algoritmo es un conjunto finito de instrucciones o pasos que sirven para ejecutar una tarea y/o resolver un problema. De un modo más formal, un algoritmo es una secuencia finita de operaciones realizables, no ambiguas, cuya ejecución da una solución de un problema en un tiempo finito.El término algoritmo no está exclusivamente relacionado con la matemática, ciencias de la computación o informática. En realidad, en la vida cotidiana empleamos algoritmos en multitud de ocasiones para resolver diversos problemas.

Algunos ejemplos son el uso de una lavadora (se siguen las instrucciones), pero no la preparación de una comida (porque no están perfectamente definidos los pasos).

También existen ejemplos de índole matemática, como el algoritmo de la división para calcular el cociente de dos números, el algoritmo de Euclides para calcular el máximo común divisor de dos enteros positivos, o incluso el método de Gauss para resolver Sistema lineal de ecuaciones.

Un algoritmo numérico es el conjunto de instrucciones ordenadas para resolver un problema que involucra procesos matemáticos (con calculo de formulas de manera repetida).

Este tipo de algoritmos no admiten ambigüedades y debe darse cada uno de los pasos para su solución.

Este tipo de algoritmos no admiten ambigüedades y debe darse cada uno de los pasos para su solución.Se define el concepto de algoritmo numérico. Se presentan varios casos de problemas numéricos, se dan sus soluciones en forma algorítmica y se agrega en cada caso una representación en forma de diagrama de flujo.

La noción de algoritmo aparece en numerosas y disímiles situaciones de la vida cotidiana y es manejada por una gran cantidad de personas, algunas de las cuales ni tan siquiera conocen su existencia.

De manera informal, un algoritmo puede definirse como una lista de instrucciones mediante las cuales puede llevarse a cabo un determinado proceso.

Los métodos numéricos permiten resolver problemas obteniendo aproximaciones para las soluciones mediante algoritmos iterativos. Estos algoritmos reciben el nombre de algoritmos numéricos.

Ejercicio 1 Menciona 3 lugares donde apliques algoritmos numericos en tu vida cotidiana:

Ejercicio 2 ¿Que es un algoritmo?

Publicado por : Ismael Alfonso Iturbe Izquierdo